攝影機是以高畫質如實捕捉數據資料最精密的機器。如同人類的眼睛,攝影機可以捕捉細膩的影像和生動的畫質,其他的感測器如雷達、超音波和雷射,都無法呈現如此美麗的細節。從全球各地洞穴發現的數萬年前史前繪畫,可以證明圖像和繪畫輔以感官視覺是傳遞精確資訊的最佳方法。

有人說,科技界下一個最富挑戰性的尖端工程,就是即時機器視覺和智慧化。其應用包括但不限於:即時醫療分析(手術機器人)、擁有自主智能的工業用機器和汽車。此系列文章將聚焦在自主先進駕駛輔助系統(ADAS)應用,並探討為何攝影機和立體視覺是汽車可以安全又自主地「看見」和「駕駛」的關鍵。

如何選擇攝影機?

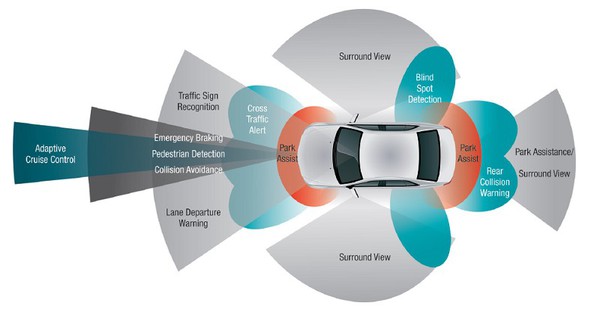

ADAS需要攝影機的關鍵應用如圖一所示,有些應用只需一套視覺系統,例如前置、後置和側置攝影機,即可偵測車道、行人、辨識交通號誌、偵測盲點和車道。其他如融合雷達數據和攝影感測器的智能主動車距控制巡航系統(ACC),在面對複雜的情況如市區交通、彎曲道路或高速駕駛時,更顯重要。

| 圖一 : 汽車ADAS的攝影機感測器應用:(a)前置攝影機—車道偵測、行人偵測、交通號誌辨識和緊急煞車(b)側置和後置攝影機—停車輔助、盲點偵測和兩側來車警示系統(Cross Traffic Alert) |

|

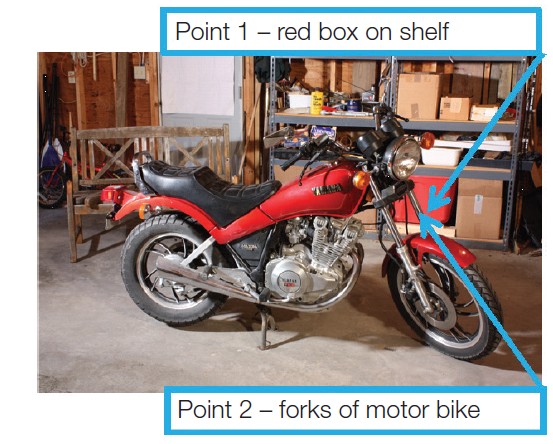

攝影機所拍攝的真實世界是三維的。而真實世界中不同景深的物體,在錄影感測器的二維映射世界中看起來會彼此相鄰。圖二顯示的是Middlebury圖片集的照片;顯然地,照片前景的摩托車比後方的儲物箱靠近攝影機大約兩公尺。請注意圖中標註的點1和點2。背景中的紅箱子(點1)看起來就在摩托車叉的旁邊,即使紅箱子距離攝影機至少二公尺遠。人類的頭腦具有透視的能力,能夠讓我們從2D場景判斷景深的遠近,不過對汽車的前置攝影機來說,透視分析並不容易。

| 圖二 : 2014年Middlebury圖片集照片。前景中的摩托車比儲物櫃靠近攝影機,儘管在2D平面圖所有的物體看起來都相鄰。 |

|

如果我們安裝一支攝影感測器,拍攝到的影片必須進行後製處理和分析,這個系統就叫做單眼(Single-eyed)系統;擁有兩支獨立攝影機的系統,則稱為立體視覺系統。單眼攝影機系統的分析能力可以正確辨識行徑路線中的車道、行人、交通號誌以及其他車輛,但該系統比較無法做到的是,從它的單眼感測器所接收的2D平面影像來計算真實世界的3D影像。對生來就有兩隻眼睛的人類和大多數較進化的動物來看,這並不令人意外。

分析單眼攝影機拍攝的影片(影像)高階流程和演算法來看,第一階段是影像預處理步驟,透過影像(通常指的是每一個像素)濾波器,除去感測器噪音和其他不需要的訊息。這個階段也會把從攝影機感測器接收到的BAYER數據格式,轉換成可以讓接下來的步驟進行分析的YUV或RGB格式。

完成第一階段特徵預除(邊緣、哈爾、賈伯濾波、方向梯度直方圖)後,第二和第三階段會進一步分析影像,透過分割、光流、區塊比對和模式辨識等演算法找出感興趣區域(Regions of Interest)。最後一個階段運用先前階段產生的區域資訊和特徵資料,針對感興趣區域的物體級別做出智能分析決策。這個簡短的解釋不完全說明ADAS影像處理演算法,但由於本文的目的是要凸顯立體視覺系統所帶來的額外挑戰和強大的功能,區塊演算法的相關資訊已足以讓我們深入地探討這個主題。

單眼攝影機如何從2D數據測量物體距離?

單眼攝影機有兩種方法進行距離測量。第一個方法是根據一個簡單的原理:物體愈近在鏡頭裡看起來愈大,在畫面中所佔的畫素面積也愈大。假設有個物體被認定是汽車,它的面積可以透過計算覆蓋其上的最大矩形面積得出。矩形面積愈大,物體(例如汽車)就愈靠近攝影機。緊急剎車演算法即是藉由計算畫面裡兩個物體的距離,是否比預設的安全數值還要近,來決定是否要啟動防撞或駕駛人警示措施。

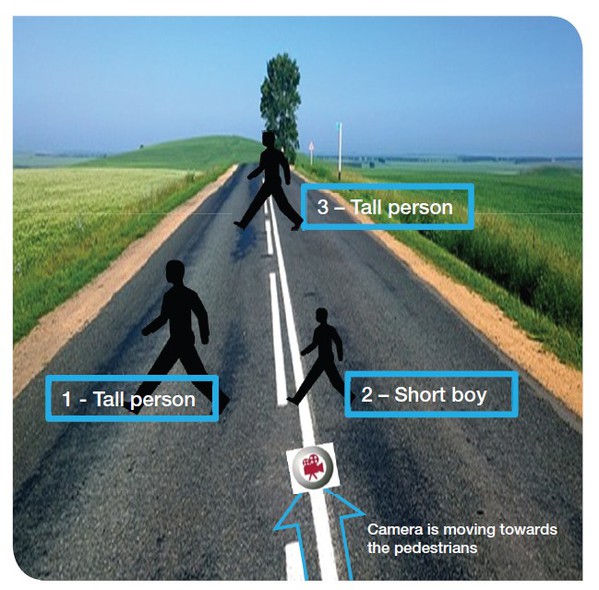

這個方法的優點是簡單明瞭,不過卻有幾項缺點。首先,物體必須先被正確的辨識,否則無法正確計算物體的距離。例如圖三的情境,有三個行人圖形。行人1是個高個子,行人2是個小男孩,這兩個行人與攝影機的距離相同。行人3距離攝影機較遠,也是個高個子。物體偵測演算法辨識後會在這三位行人上畫出矩形。很不幸的,覆蓋在離攝影機較近的小男孩(行人2)身上的矩形面積與覆蓋在離攝影機較遠的高個子(行人3)身上的面積是相同的。因此,2D影像中的物體畫素面積並非計算物體與攝影機距離的完美可靠指標。另一個問題是,倘若場景中的物體無法被辨識,距離就無法確定,因為該演算法無法得知物體的畫素面積。有許多原因造成物體無法被辨識,例如遮擋、光線、圖像偽影。

| 圖三 : 此虛擬圖顯示移動汽車的攝影機所拍攝到3位行人。行人3和行人2的畫素面積一樣大,但行人2卻比行人3距離汽車近得多。 |

|

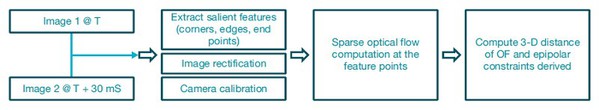

使用單眼攝影機計算物體距離的第二個方法稱為從運動恢復結構原理 (structure-from-motion, SFM)。由於攝影機理論上是在移動中,透過比對連續拍攝的畫面可以找出重要特徵。對極幾何原理(Epipolar geometry)先定義一個約束參數,從移動中(或翻轉中)的攝影機連續拍攝的二個畫面中,找出一個畫素點,約束參數就是此點在3D空間移動的方向。圖四即為SFM計算距離的高階數據流程。

| 圖四 : SFM計算距離的高階數據流程。稀疏光流(OF)可以被稠密光流(圖像上所有畫素點的光流)計算取代。上述光流假設是30fps。 |

|

(本文作者Aish Dubey任職於德州儀器)

**刊頭圖(Source:YouTube)